Biologie učení posilováním je popsána na stránkách Operantní podmiňování a Odměna.

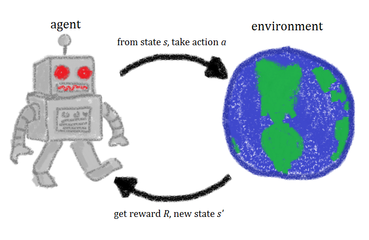

Učení posilováním (Reinforcement Learning, RL) je učení softwarového agenta, jak se má chovat v prostředí, tím, že mu říkáme, jak dobře si vede. Jedná se o oblast strojového učení inspirovanou behavioristickou psychologií.

Učení s posilováním se liší od učení pod dohledem, protože správné vstupy a výstupy nejsou nikdy zobrazeny. Na rozdíl od učení s dohledem se posilování obvykle učí za pochodu (online učení). To znamená, že agent musí volit mezi zkoumáním a setrváním u toho, co zná nejlépe.

Základní pojmy

- Agent – entita, která volí akce.

- Prostředí (environment) – vše, s čím agent interaguje; po každé akci vrací nový stav a odměnu.

- Stav (state) – popis aktuální situace prostředí (může být plně nebo částečně pozorovatelný).

- Akce (action) – rozhodnutí nebo krok, který agent provede.

- Odměna (reward) – okamžitá hodnota, která říká, jak byla akce dobrá; cílem agenta je maximalizovat kumulativní odměnu.

- Politika (policy) – pravidlo, podle kterého agent vybírá akce (deterministická nebo stochastická).

- Hodnotová funkce (value) – odhad očekávané další kumulativní odměny z daného stavu nebo páru stav–akce.

- Model – předpověď dynamiky prostředí (přechodů stavů a odměn); model-based metody ho využívají, model-free ne.

- Diskontní faktor (γ) – číslo 0–1, které určuje, jak dalece se upřednostňují okamžité odměny před budoucími.

Cíl učení

Cílem je nalézt politiku, která maximalizuje očekávaný kumulativní (často diskontovaný) součet odměn, např. E[∑_{t=0}^∞ γ^t r_t]. V praxi jde o učení z interakcí bez zpřesněného učitele – agent zkouší, získává odměny a postupně zlepšuje své chování.

Klíčové principy a problémy

- Explorace vs. exploatace – dilema mezi zkoušením nových akcí (možná lepších) a využíváním známých dobrých akcí. Praktiky: epsilon-greedy, softmax, UCB.

- Kreditní přiřazení (credit assignment) – jak připsat zásluhy nebo vinu jednotlivým akcím za odložené výsledky.

- Sparse rewards – když jsou odměny vzácné, učení je obtížnější; řešení: shaping odměn, relabelling, intrinsické motivace.

- Částečná pozorovatelnost – když agent nevidí celý stav (řeší se pamětí, RNN, POMDP přístupem).

- Stabilita a sample-efficiency – zejména u reálných aplikací (robotika, finance) je důležitá efektivita využití dat a stabilita učení.

Hlavní třídy algoritmů

- Model-free hodnotové metody – např. Q-learning, SARSA; učí hodnoty akcí bez modelu prostředí.

- Policy-based metody – přímo optimalizují politiku (např. REINFORCE, policy gradient metody); vhodné pro spojité akční prostory.

- Actor-critic – kombinuje politiku (actor) a hodnotovou funkci (critic) pro stabilnější a efektivnější učení.

- Model-based metody – agent vytváří nebo využívá model prostředí pro plánování; často sample-efektivní, ale náchylné na chybný model.

- Deep Reinforcement Learning – použití neuronových sítí jako aproximátorů (např. DQN, Deep Deterministic Policy Gradient, PPO); umožňuje škálovat do složitých vizuálních či spojitých úloh.

Praktické techniky a tipy

- Normalizovat vstupy a odměny, používat replay buffer a cílové sítě (target networks) u DQN pro stabilitu.

- U policy-gradient metod používat baseline (např. hodnotovou funkci) ke snížení variance gradientů.

- Reward shaping s rozmyslem – pomáhá, ale může vést k nechtěným vedlejším efektům (reward hacking).

- Testovat generalizaci na různých instancích prostředí a měřit sample-efficiency.

Aplikace

- Hry (Atari, šachy, Go) – známé úspěchy deep RL.

- Robotika – učení ovládání, manipulace a pohybu.

- Systémy doporučení a řízení provozu – optimalizace dlouhodobého cíle.

- Finanční obchodování, plánování výroby, řízení zdrojů a další rozhodovací systémy.

Výzvy a etika

Mezi hlavní výzvy patří bezpečnost (bezpečné nasazení v reálném světě), robustnost vůči odchylkám prostředí, etické aspekty (neúmyslné chování, diskriminace) a interpretovatelnost naučených politik. Důležitá je kontrola a validace chování agenta mimo tréninkové prostředí.

Učení posilováním propojuje techniky z informatiky, statistiky a kognitivních věd a má silné paralely s biologickým operantním podmiňováním a principy odměny, jak bylo uvedeno na začátku.